Jakarta (pilar.id) – Nvidia, Senin (13/11/2023) lalu, meluncurkan fitur-fitur baru pada chip andalannya untuk kecerdasan buatan. Penawaran baru ini dijadwalkan akan diluncurkan pada tahun depan dan bekerja sama dengan Amazon.com, Google dari Alphabet, serta Oracle.

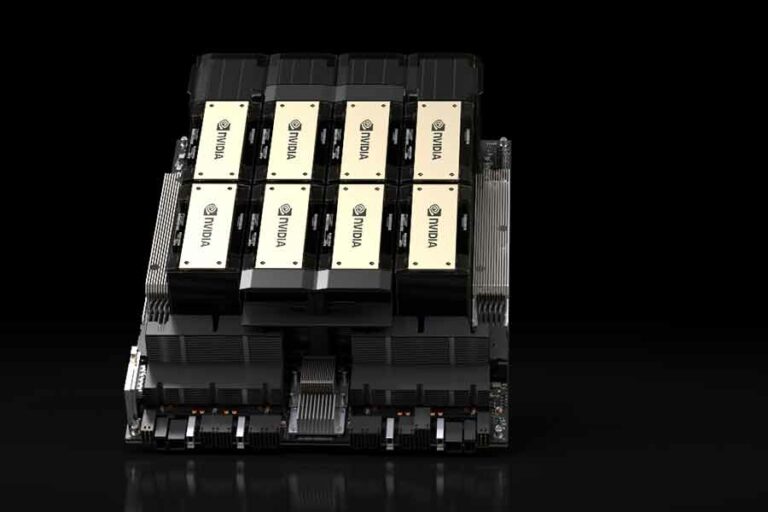

Chip terbaru yang diberi nama H200 ini akan menggantikan chip puncak Nvidia saat ini, H100. Peningkatan utamanya terletak pada memori dengan bandwidth tinggi, sebuah komponen kunci yang menentukan seberapa cepat data dapat diproses.

Nvidia, yang mendominasi pasar chip kecerdasan buatan, mendukung berbagai layanan kecerdasan buatan generatif, termasuk layanan ChatGPT dari OpenAI, yang mampu memberikan tanggapan dengan cara menulis yang menyerupai gaya manusia.

Peningkatan dalam memori dengan bandwidth tinggi dan koneksi yang lebih cepat ke elemen pemrosesan chip memungkinkan layanan semacam itu memberikan jawaban dengan lebih cepat.

H200 memiliki memori dengan bandwidth tinggi sebesar 141 gigabyte, meningkat dari 80 gigabyte pada chip sebelumnya, H100. Nvidia tidak merinci pemasok memori untuk chip baru ini, tetapi pada bulan September, Micron Technology menyatakan bahwa mereka sedang bekerja untuk menjadi pemasok memori Nvidia.

Nvidia juga mengumumkan bahwa Amazon Web Services, Google Cloud, Microsoft Azure, dan Oracle Cloud Infrastructure akan menjadi penyedia layanan awan pertama yang menawarkan akses ke chip H200, bersama dengan penyedia layanan awan kecerdasan buatan spesialis seperti CoreWeave, Lambda, dan Vultr. (hdl)